Algoritmit oikeudellisen päätöksenteon tukena

Mika Sutela

Kirjoittaja on väitellyt Itä-Suomen yliopiston oikeustieteiden laitokselta.

Voitko kuvitella päivän, jolloin tekoäly tukee oikeudellista päätöksentekoa? Tekoälytuomarin aikakausi voi olla luultua lähempänä. Hurjaa vauhtia arkipäiväistyvällä tekoälyllä tarkoitetaan yleensä ihmisten älyllistä toimintaa imitoimaan pyrkivää tietotekniikkaa. Älyllisessä toiminnassa ovat mukana myös tunteet sekä jonkinasteinen tietoisuus. The Curious AI Companyn toimitusjohtaja Harri Valpola totesi Ylen Perjantai-ohjelmassa (9.3.2018), että ihmiset haluavat nähdä älyn kiinni jossakin fyysisessä laitteessa, ja siksi robotit kiehtovat kovasti ihmisiä, mutta tekoälyn kehitys menee jossakin muualla. Tällä hetkellä kaikkein kehittyneimmät tekoälyt ovat puhdasta ohjelmistoa.

Analytiikasta puhuttaessa on usein kyse algoritmeista, jotka ymmärtävät ihmisten käyttäytymistä. Arjessamme taustalla olevat algoritmit tiedostamattamme määrittävät Google-hakujen tuloksia, Yle Areenassa suositeltuja ohjelmia ja Spotifyssä suositeltua musiikkia, sosiaalisessa mediassa näkemiämme julkaisuja sekä verkkokaupan mainoksia. Esimerkiksi verkkokauppaa personoidaan aiemman käyttäytymisen mukaan, mikä vaikuttaa sivuston visuaalisuuteen, tuotesuosituksiin ja kampanjoihin. Lisäksi algoritmit muun muassa ennustavat vaalituloksia ja seulovat työhakemuksia.

Algoritmit ovat valtaosin liikesalaisuuksia, joiden mekanismeja ei paljasteta ulkopuolisille. Ongelmallista on, ettei niiden tuottamia tuloksia voida arvioida. Tuomarin on tiedettävä, miten algoritmi toimii ja mitä dataa sen kehittämiseen on käytetty. Voi kuitenkin olla, etteivät edes ohjelmoijat tiedä, millä perusteilla algoritmit suosituksiinsa päätyvät. Läpinäkyvyyden puuttuessa tuloksiin päädytään ilman, että kukaan tietää, millä perusteilla niihin on päädytty.

Helsingin yliopiston tietojenkäsittelytieteen professori Tommi Mikkonen ei ole huolissaan algoritmeista; ne ovat ihmisten tekemiä ja ihmisten hallittavissa. Tässä hengessä algoritmit tavataan esittää puolueettomina ja matemaattisen neutraaleina, mutta silti ne sisältävät aina laatijoidensa oletuksia. Neutraalit algoritmit päätyvät toistamaan ihmisten ennakkoluuloja, koska algoritmien käyttämä data on ihmisten ennakkoluulojen muokkaamaa. Algoritmit perustuvat aiemmin tehtyihin valintoihin ja asenteisiin. Kun yliopistoja paremmuusjärjestykseen laittava algoritmi vertailee mm. tieteellisten julkaisujen määriä, sisäänpääsyprosentteja ja valmistusaikoja, algoritmin tekijät olettavat, että nämä seikat kuvaavat parhaiten yliopistojen menestymistä. Tulos voisi olla toinen, jos huomioon otettaisiin myös esimerkiksi opiskelijoiden taustat.

Digitalisoitumisen moninaiset vaikutukset oikeudenhoitoon, lakimiestyöhön sekä kansalaisten oikeuksiin on yhä akuutimpi kysymys, joka muuttaa sekä koko oikeudenhoitoa että yksittäisen lakimiehen työtä lähitulevaisuudessa. Hankejohtaja Marko Loisa oikeusministeriöstä on pohtinut, että poliisi–syyttäjä–tuomioistuin -akselilla on paljon sellaista, mitä voitaisiin analytiikkatyökaluja käyttämällä automatisoida ja sujuvoittaa. Poliisi voi hyödyntää dataa tehdessään päätöksiä, minne ja milloin resursseja on suunnattava. Tietokone voidaan opettaa lukemaan pykäliä ja tulkitsemaan oikeustapauksia. Kone pystyy lyhyessä ajassa käymään läpi merkittävästi enemmän tapauksia kuin yksikään ihminen. Asianajajan ammatissa riitely on ydinasia ja sitä se tulee olemaan myös tulevaisuudessa. Tästä huolimatta tekoäly on asianajoalalla jo nyt kuuma aihe, sillä tekoälyä voidaan käyttää tukemaan päätöksentekoa ja automatisoimaan mekaanisempia tehtäviä säästäen asianajajan aikaa rutiininomaisilta paperitöiltä.

Oikeussaleissa on jo kokeiltu algoritmeihin perustuvaa data-analytiikkaa ja päätöksentekoa. Tietokonealgoritmeihin perustuvia järjestelmiä on käytetty uusimisriskin arviointiin Yhdysvalloissa jo ainakin toista vuosikymmentä. Yhdysvaltojen kymmenissä osavaltioissa tuomarit ovat saaneet päätöstensä tueksi COMPAS-järjestelmän algoritmien suorittamia laskemia siitä, millä todennäköisyydellä oikeuden eteen tuotu henkilö syyllistyy uudestaan rikokseen. Algoritmien laskelmissa on huomioitu 137 erilaista muuttujaa, jotka ennustavat todennäköisyyttä, jolla rikollinen syyllistyy uuteen rikokseen, jää kiinni ja tulee tuomituksi. Ongelmaksi tässä muodostuu aineisto: uusimisasteen ajatellaan kertovan siitä, kuinka todennäköisesti henkilö tulevaisuudessa tekee rikoksen, mutta tietoa on kuitenkin vain rikoksista kiinnijääneistä ja tuomituksi tulleista, mikä tuottaa järjestelmällisen harhan. COMPAS-järjestelmä on kuitenkin vähentänyt tuomareiden henkilökohtaisten käsitysten merkitystä, mikä on johtanut johdonmukaisempiin tuomioihin.

Muuan englantilais-amerikkalainen tutkijaryhmä puolestaan tarkasteli tutkimuksessaan Euroopan ihmisoikeustuomioistuimen ratkaisuja ja havaitsi, että tekoälytuomari ennusti 584:stä aiemmin tehdyistä ratkaisuista 79 prosenttia oikein. Tutkijoiden mukaan EIT:n päätökset olivat vahvemmin yhteydessä tapausten ei-oikeudellisiin seikkoihin kuin suoraan oikeudellisiin argumentteihin. Havainto tukee aiempia tuomioistuinten päätöksenteosta tehtyjä tutkimuslöydöksiä. Yksi luotettavampia päätösten selittäjiä oli niissä käytetty kieli.

Ihanteellinen tuomari on kuin kone, joka ei anna väsymyksen, omien tunteidensa, mieltymystensä tai näkemystensä vaikuttaa päätöksiin. Ihminen ei kuitenkaan ole kone. Rangaistuksen määräämisen ollessa yksi tärkeimmistä osavaiheista rikosprosessissa, algoritmeilla on suuri potentiaali apuvälineenä ratkaisujen tuottamisessa oikeusturvan sekä yhdenmukaisuuden näkökulmasta. Algoritmit eivät tule korvaamaan oikeudellista harkintaa ja perinteisiä tuomareita, mutta niillä tulee varmasti olemaan entistä tärkeämpi rooli rikoslainkäytössä. Rikokset ja tilannekohtaiset tekijät ovat aina uniikkeja, eikä kahta samanlaista tapausta ole olemassa. Algoritmit eivät kykene ottamaan huomioon kaikkia yksittäistapausten erityispiirteitä, minkä vuoksi tuomareiden on tehtävä varsinainen päätös. Kun algoritmien tulosten käyttö on ohjeellista, ja tuomarit hyödyntävät niitä oman harkintansa mukaisesti, säilyy päätöksenteossa inhimillinen puoli.

Ihminen laumaeläimenä tekee miten muutkin tekevät. Algoritmit tehostavat sekä yksilöllisyyttä että laumakäyttäytymistä paitsi helpottamalla sopivan, oikeudenmukaisen rangaistuksen määrittämistä, myös kertomalla, mitä yleensä samankaltaisista rikoksista tuomitaan rangaistukseksi. Vaikka algoritmeilla on omat rajoitteensa, ne voivat joka tapauksessa edistää rangaistuskäytännön yhtenäisyyttä. Kun tuomari tekee päätöksen algoritmiperusteisen suosituksen pohjalta, esimerkiksi se, milloin oikeudenkäynti pidetään tai millainen olo tuomarilla on kyseisenä päivänä, ei vaikuta niin todennäköisesti päätökseen. Algoritmit, jotka poistavat muun muassa vastaajan sukupuolen, etnisen taustan ja kotipaikan vaikutukset, poistavat harhaisuutta, joka liittyy ihmisten tekemiin päätöksiin.

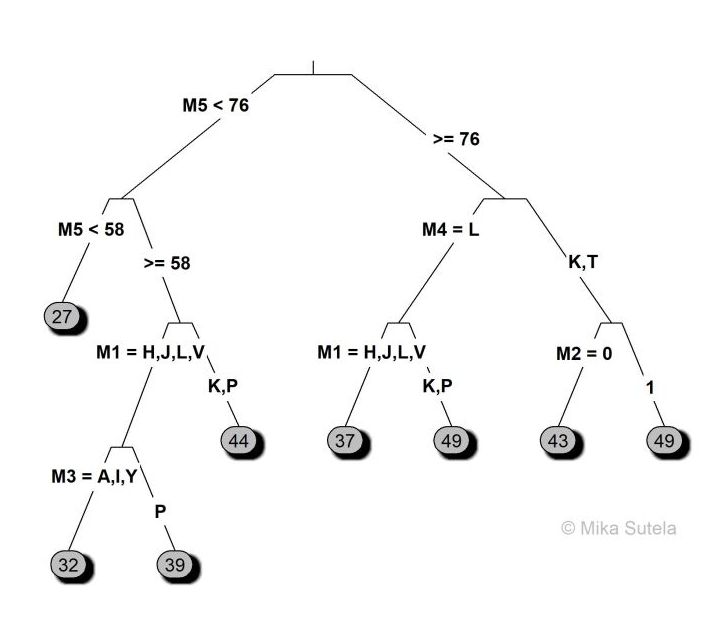

Tuomareita avustavien algoritmien tulisi olla läpinäkyviä. On pyrittävä siihen, että tuomittavana oleva henkilö saisi tietoa ratkaisun taustoista. Perinteiset dataa hyödyntävät menetelmät, kuten esimerkiksi klassiset tilastomenetelmät, ovat yleensä melko läpinäkyviä. Nämä ovat kuitenkin vaarassa unohtua tekoälykeskustelun lomassa. On muistettava, että tekoäly on vain yksi datan hyödyntämisen menetelmä muiden joukossa. Jo melko yksinkertaisilla kuvailevilla analyysimenetelmillä olisi mahdollista antaa tukea oikeudelliseen päätöksentekoon. Toisinaan jopa yksinkertaiset tilastolliset peukalosäännöt ovat likimain yhtä tarkkoja kuin monimutkaiset algoritmit. Tilastolliset peukalosäännöt toimivat parhaiten silloin, kun tavoitteet ovat selkeästi määriteltyjä ja kun dataa on tarjolla aiemmista ratkaisuista.